Il y a quelques temps que j'y pensais et à vrai dire lorsque certains gouvernements ont commencé à parler de son interdiction je me suis dis: je vais m'y intéresser. Tout de même interdire un produit car il semble super dangereux, un produit qui s'achete librement pour un peu plus de 100€ ... ça semble énorme ... et ça ressemble surtout à du bullshit !

Alors le flipper zero dangereux ? Clairement entre des mains lambda, non !

Alors pourquoi cet engouement pour le flipper zero et pourquoi cette peur ?

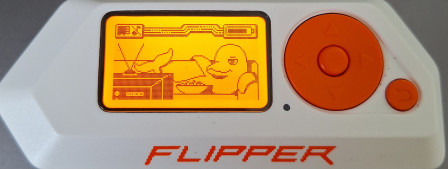

Pour un hacker: alors attention quand je dis hacker je parle d'une personne qui aime bien bidouiller, détourner des choses et analyser comment elles fonctionnent le tout pour le fun, pas d'un pirate, l'avantage c'est sa taille, les interfaces GPIO (General purpose input output), ses applications et les fréquences qu'il prend en compte par défaut et les possibilités de personnalisation. Sans compter sur flipper: oui le petit dauphin en interface, et plus vous utilisez l'appareil, plus il est content et évolue :) (oui en gros en plus c'est un tamagotshi :)).

Mince, maintenant que j'ai dis que ça pouvait être utilisé par des hackers on va croire que c'est dangereux c'est sur on va tous mourrir à cause de flipper le dauphin !!!

Alors pour faire simple non: soyons clair si les appareils que vous utilisez respectent les bonnes pratiques de sécurités et si vous même vous le faîtes, le flipper zero n'est pas dangereux. Et même avec une sécurité basique, le flipper zero sans plus d'intervention de l'utilisateur: en modifiant des données, ou en ajoutant des modules au flipper zero par exemple. Et clairement le flipper zero, à part par sa portabilité, et tout de même moins "puissant" qu'un bon vieux HackRF.

Pourquoi parle-t-on de l'interdire ?

Bonne question, avec tout ce qui est numérique les politiques agissent bizarrement: imaginons que de nombreux vols aient lieu dans des boutiques par des cambrioleurs qui cassent les vitrines avec un marteau-masse FACOM. La bonne pratique dirait: ok donc on condamne les auteurs et pourquoi on force les fabriquants de vitrine à respecter des normes de solitidités. Bah non dans notre monde magique les politiques veulent alors interdire les marteaux-masses FACOM ! C'est exactement la même chose avec le flipper zero !

Mais exactement qu'est-ce que l'on peut faire avec (par défaut):

- Découvrir, capturer, identifier et retransmettre des fréquences entre 300 et 925 MHz

- Lire et émuler des cartes RFID

- Lire et émiler des cartes NFC

- Capturer et envoyer des signaux infrarouges (donc vous pouvez utiliser le flipper zero comme télécommande :))

- Des "attaques" de type BadUSB

- Vous pouvez vous en servir pour le MFA car il peut faire Universal second factor

- Lire, écrire et émuler des iButtons

- Vous pouvez jouer à snake !

Oui ça fait peur cette liste: mais en soit: rien de nouveau et dans son fonctionnement par défaut, on a normalement, et ce depuis des années, les processes, bonnes pratiques et outils techniques permettant de résister à tout cela ... encore une fois ... le vritrine et le marteau quoi !

Sinon je suis très content de mon flipper zero: ça permet de tester la sécurité de sa domotique, de voir aussi simplement ce qui "se passe" dans le coin et de se remettre de manière lidique au Radio Fréquence histoire de garder mon dauphin heureux ! Et du coup je pense que LE truc le plus dangereux c'est ça, car oui bizarrement ça pousse à avoir envie de s'amuser avec !

Allez je vous laisse sur ceci ! Et clairement si ce genre d'outil peut forcer les fabriquant à fournir des produits plus sécurisés c'est tant mieux !

Comme d'habitude: ce texte est bien sûr en licence CC BY-SA 4.0 (legal)